|

海明威的《老人与海》,大家都很熟悉吧?你们的高中老师当年是怎么教这篇课文的呢?朗读、背诵、讲 PPT? 这一切将被改变!你能想象吗,不苟言笑的语文老师在课堂上变身「演员」,《老人与海》中巨大凶猛的马林鱼向他袭来,而他向后一个趔趄,躲避开这个危险的生物… 没错,这正是在融合了最新的 VR、AR 技术后的课堂教学方式,让老师和学生能在探险般的故事里「身临其境」。  ▲ 海洋探险,讲故事的新方式

虽然当前 VR、AR 技术已进入成熟阶段,但据 EDUCAUSE 发布的数据显示,仅有 4% 的学生在 2018 年通过虚拟现实和增强现实等视听新科技辅助过他们的学习。技术创新在教育领域中的应用仍有很大的可挖掘的空间。 教育学家、科学家、工程师、设计师甚至追梦者们都在尝试使用科技的力量辅助教育,如何将 VR、AR、MR 技术与教育结合成为了重点研究的方向之一。近日,硅谷洞察走进了麻省理工学院媒介实验室(MIT Media Lab),探寻那里的研究者们就如何用 AR 技术打造更具吸引力的课堂。 AR 将打造「实时交互式」的课堂教学方式

▲ Nazmus Saquib 在麻省理工学院的媒介实验室,Yaling Hou 摄

Nazmus Saquib(后简称 Saquib)是麻省理工学院的一名博士生。今年年初,他与 Adobe 研究院的研究员们就如何运用新媒介更好的展示教学内容、帮助教师提高课程吸引力开展了一项技术试验。 发起这个实验项目的初衷,是 Saquib 想改变教师在授课中总照着 PPT 干巴巴念着板书的模式。受到 AR 增强现实的启发,拥有人工智能开发和机器深度学习背景的 Saquib 和团队想要将「肢体语言」引入一项交互式演示的系统中,辅助教师更好的将知识可视化、生动化的展现给学生,他们将此开发系统命名为 Interactive Body-Driven Graphics for Augmented Video Performance,后文就将它简称为 AR 实时交互式系统。 那么,这款产品是怎么运用到教学中去的呢? 这个系统可以让用户独立设计互动方案和原创故事,让用户在不同的场景里用自然的肢体动作和姿势操控图表元素。 使用该系统,老师会和现实场景(课堂)中不存在的事物同时出现。老师还必须是「戏精」本人,在现场使用肢体动作和姿势实时操控这些图表信息,真正达到「声情并茂」的演绎出教学内容的目标。

▲ 鲸鱼结构讲演

比如老师今天上课的内容是介绍一种海洋生物:鲸鱼。传统的多媒体教学会给学生展示一条鲸鱼在屏幕上,用箭头标注出这些部位分别叫什么。但是利用 Saquib 他们开发的系统,教师可以在视频中和这条鲸鱼实时互动,通过上下抬臂这个动作「打开」鲸鱼,让同学们看到鲸鱼内部骨架结构、五脏器官构造和外部皮层的关联。 与图文互动,除了让学生们觉得老师上课新颖有趣、知识点更好理解外,也让教师们将图文、声音、语言和肢体动作等多重传递信息的方式相结合,极大的帮助他们更好的表达信息。

▲ 研究太阳起落与湿度的变化关系

▲ AR 技术演示做饭

▲ AR 为学生添加天使翅膀

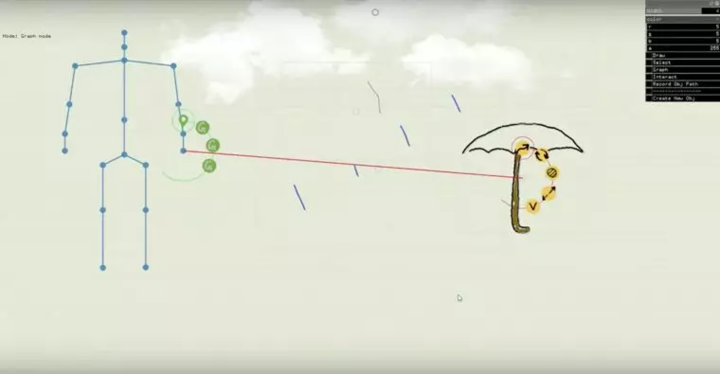

这个系统让我们看到了除幻灯片外,还有更具互动性与趣味性的工具可被教师在上课时使用。这款工具还打破了传统 AR 程序前期编程后期无法更改的特点,提供实时增强现实的特效。 听起来似乎需要很复杂的特效剪辑才能做到这样的效果。那么这款工具对普通教师来说好用吗?便于操作吗? Saquib 说只要教师会做 PPT,并通过简单的培训,就可以自主掌握这款 AR 交互系统。他给我们展示了他是如何使用这款工具做到用户设计交互表达并讲好一个故事的。 教师在打开系统后,会看到这个人形的大框架。蓝色的「人架子」上,每一个圆点代表着人体可移动关节的 19 支点,如:头、颈、肩、肘、手、腰、腿部关节等。右边是 Saquib 用鼠标画出来的一把雨伞,他还向系统导入添加了云和雨滴,用于辅助教学的图像元素。导入的过程就像 PPT 导入图片一样简单。

▲ 图片由 Nazmus Saquib 提供

接下来,Saquib 想要在演示时用自己的左手撑伞。要完成这一套动作,只要拖动鼠标,找到「左手」支点,将「左手」与「雨伞」相连即可,相连的位置也是可以设计的。 在雨伞旁边,会出现五个黄色的小图标,这些小圆圈代表了该图像元素本身将如何运动:从上到下依次代表了:移动、旋转、改变透明度、变大变小和速度。这些功能是 Saquib 和团队成员们通过对演讲者演示时行为的研究得到的最常用的五种形变方式。

▲ 人体支点连接虚拟雨伞,并出现 5 种形变位移图标

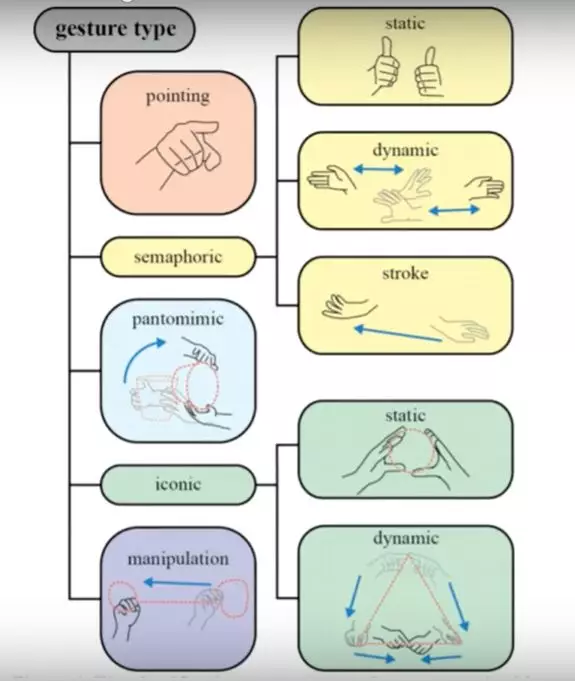

所以按照这样的设计逻辑,如果想让雨伞在 Saquib 拿到之后变大,他仅需要点击雨伞旁边代表大小的黄色图标即可。 此外,系统中还预设好了一些手势的「快捷方式」,帮助教师用简介的动作完成会重复出现的高频互动反应,如「食指指向」选定后,「双手竖起大拇指」控制图表保持固定,「手部左右摆动」控制方向移动,摆动控制图表摆动等。

在系统上设计好这些元素和其运动方式后,就到了正式表演的时候了。

▲ 图片由 Nazmus Saquib 提供

这是一张 Saquib 在家里使用系统工具的照片。通过画面你可以看到制作的场地不受限制,只需一位讲师、一块屏幕、一台传感器(即图中的 Kinect)、一部电脑和一个(手上握着的)点击器就可以开始录制了 。这台电脑的摄像头可以拍到 Saquib,电视屏幕相当于一面镜子,S 可以通过看屏幕看到自己的表现,并设计自己的互动动作。

▲ 自定义设计好交互图表后的效果展示

可以看到,这款系统还是很好理解,并可以快速上手的。这对于没有编程、设计基础的教师来说,从接触到掌握不是一件难事。 虚拟画面现实场景中「实时反馈」是 Saquib 团队 AR 实时交互系统的亮点。 通过深度学习(machinelearning),即利用人工智能将人类行为动作的数据收入到数据库中,Kinect 就可以感知并识别演示者动作的目的。当 Saquib 举起手指向斜上方时,一个图表就会出现在视频上, Kinect 会迅速反应并判断「操作者」做出这一指令动作的目的,将之前设置好的图表信息实时显示到屏幕上。 比如这个航海的舵盘,当屏幕上的 Saquib 握着舵盘「航行」的时候,图表信息会随着 Saquib 的移动而做出变化。  ▲ 实时出现的虚拟图表,数值更具演示者的变化而变动

这就是 Saquib 一直强调的关键词「实时」互动。这款工具的亮点和特色正是在视频中实时显示增强现实的 AR 画面,现场配合教师,完成一场自定义的「表演」。 此外,Saquib 还表示,AR 教学将成为信息传递的新媒介,帮助更多的人认知这个世界。在 MIT Media Lab, Saquib 和其他学生、学者一直致力于研究除声音、画面、文字外,还有什么新型「语言」可以传递信息并且帮助更多的人,为获取信息提供创新性途径和工具。

▲ MIT Media Lab 一角,Yaling Hou 摄

Saquib 萌生出做 AR 实时交互演示工具也是想探讨「肢体」语言对信息传递的效率和用途,打造未来创新型互动教室。 有人可能会有这样的疑问,通过在笔记本上写字、画图这种最传统的「语言」方式不是一样能扎实的掌握知识吗?为什么要开发新的学习「语言」呢? 其实,未来人才培养的格局已经悄然改变。复杂、庞大、时刻在快速改变着的社会告诉我们,传统的「语言」在学习中固然重要,但是创新性新「语言」的诞生可以激发我们不曾发觉的大脑潜力,辅助我们更好的换个角度看世界。 与此同时,科技的发展带给人类的应该是更多可以共享的教育资源、以及公平的学习机会。新媒介语言的诞生和创新,可以为更多拥有读写障碍或需要特殊教育的儿童(如自闭症患者)打开认知世界的新窗口。 「有些人可以快速理解逻辑性极强的数字语言;有些人则能更好的通过可视化语言(脑图、图表、视频)加强理解和记忆;还有些人可能对数字和可视化语言都不感冒。那么新「语言」的开发,其实也是在帮助不同人群寻找最适合自己的学习方式」,Saquib 说。 科技+教育要以人为本在对 MIT 媒体实验室的参观采访中,小探感受到,未来的教育并不只是科技的拼凑,而是科技更好地辅助教师,进而更好的开启学生们探索世界、思维自由驰骋的能力。所以,不论是科技还是教育,它们的本质还是重在对「人」素质的培养。 与此同时,这也客观要求教师能力可以「与时俱进」,跟上科技时代的发展。但这对对教师来说,仍是个不小的挑战。 在哈佛的科教论坛上,在国内教学一线工作了近 10 年的高宏老师和波士顿大学教育学院的教授 Stacy L. Scott 博士也跟小探一起,听取了该 MIT 团队 AR 教学系统的介绍。会后,他们都对科技与教育融合的未来充满了期待,但同时他们也都认为科技、教育发展的核心都是要更好地「服务」于人,而无论是老师还是学生也都应该顺应时代的趋势,培养使用科技的能力。 高宏老师认为,科技对教育的影响是不可逆的,是时代的必然趋势。教师除了有能力教授学生全面、系统的学习知识外,不断接受并学习新事物,快速洞察到哪些科技手段和产品可以用、怎么用,是对教师从业人员的新要求。而她目前也在哥伦比亚大学接受更加全面的教育领域学习。

跟高老师一样,Scott 博士也告诉小探,他认为未来教育的大趋势是科技辅助教育的科教结合时代。AR 交互手段确实会有效的提升课堂对学生的吸引力,但是在教师备课时,如何利用科技手段去讲好知识点和故事,这背后的功夫还是与教师的基本素养密不可分的。所以,虽然未来科技会改变教育形态,但教师所创造出的价值不会变。 「人工智能和认知科学是未来趋势,但是这些科技都是围绕着『人』来服务的。未来的教育,我认为是以人为中心的学习和设计的过程,」Saquib 在采访的最后说。 硅谷洞察

|